Можно начать с того, что моя девушка написала прекрасную

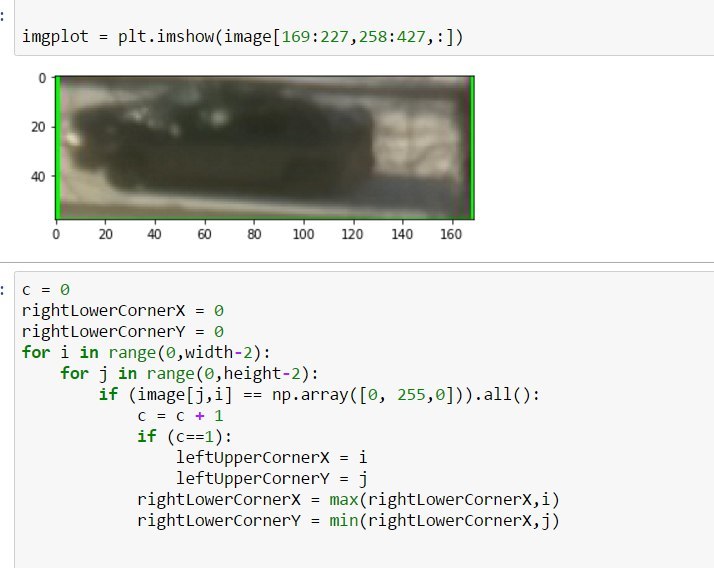

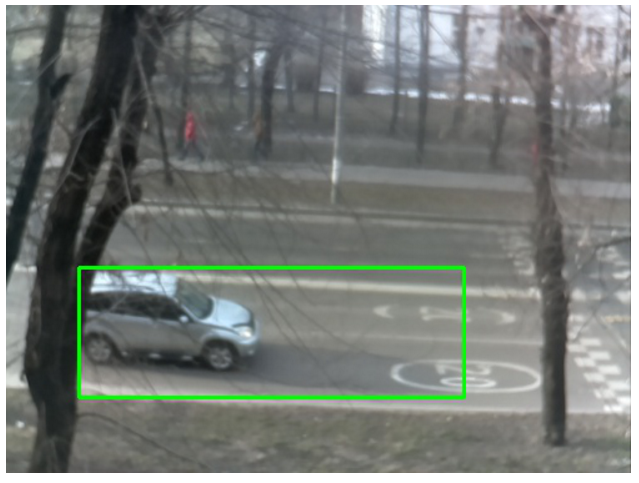

статью про свое путешествие и установку системы наблюдения за курами в курятник. Зачем? Потому что прикладная задача мотивирует гораздо больше, чем задачи на Kaggle, где все тоже далеко не идеально (лики в 1/2 задач, побеждающие архитектуры — это стеки из 15 моделей, оверфиттинг для поиска немасштабируемых закономерностей итд итп). Моя задача — написать нейросети и код на питоне, который будет отличать кур, и, возможно, логировать события в жизни кур в нашу любимую

СУБД. В процессе можно научиться много чему интересному и, возможно, даже изменить свою жизнь, поделившись своими мини-наработками.

И приятно, и полезно и весело.Можно также начать с того, что в принципе сейчас наблюдается новая ветка «пузыря» на рынке технологий — все резко побежали «в AI». Раньше все бежали в IT, в онлайн, в «бигдату», в «сколково», в AR/VR. Если посидеть в тематических российских чатах, то там люди как правило или пишут все с нуля на {

вставить свой экзотический язык} или делают одноразовых чат-ботов, осваивая средства пиарящихся корпораций. Но ведь если следовать

таким принципам в своем само-образовании, то учиться надо у ярых фанатов своего дела, которые делают то, что они делают,

не ради наживы, а ради прекрасного.

И тут мне на помощь пришел неизвестный человек, который вставил строчку в мой

файл, куда я собирал образовательные полезности в сфере работы с данными. Что удивительно, эти

люди (fast.ai — ссылка, которую кто-то вставил) проделали просто гигантскую работу по популяризации и обучению даже с нуля, следуя принципу

инклюзивности и целостности образования против

эксклюзивности и принципа «башни из слоновой кости». Но обо все по порядку.

Подход к образованию in a nutshell.

Подход к образованию in a nutshell.

Сами авторы расскажут лучше меня.

Я видел один раз в как в чате ods (если знаете что это, поймете) сформировалась команда, которая заняла второе место на соревновании по распознаванию снимков спутника, но общее количество человеко-часов нужно для такого выступления не мотивирует участвовать в таких конкурсах с учетом неидеальности мира. Также в принципе отношение вознаграждения исследователей к общей цене конкурса не внушает энтузиазма.

Поэтому все нижеописанное сделано для нейрокурятника и только для него.

На всякий случай уточню, что в мои задачи НЕ входит:

Очень толстый слой сарказма- Написать курс, чтобы потом продать лиды его молодых выпускников в Mail.ru xD;

- Писать про то, как мне нравится Caffe против Theano или Tensorflow — это все не имеет разницы до промышленного профессионального уровня, если вы не исследователь в этой сфере со стажем и не пишете научные статьи;

- Писать нейросети с нуля на {ваш экзотический язык};

- Продавать вам что-то за деньги (только идеи и бесплатно);

Я хочу поделиться прекрасными вещами и приобщить к ним максимальное число людей, дав максимально простое и широкое описание пути, который сработал для меня.